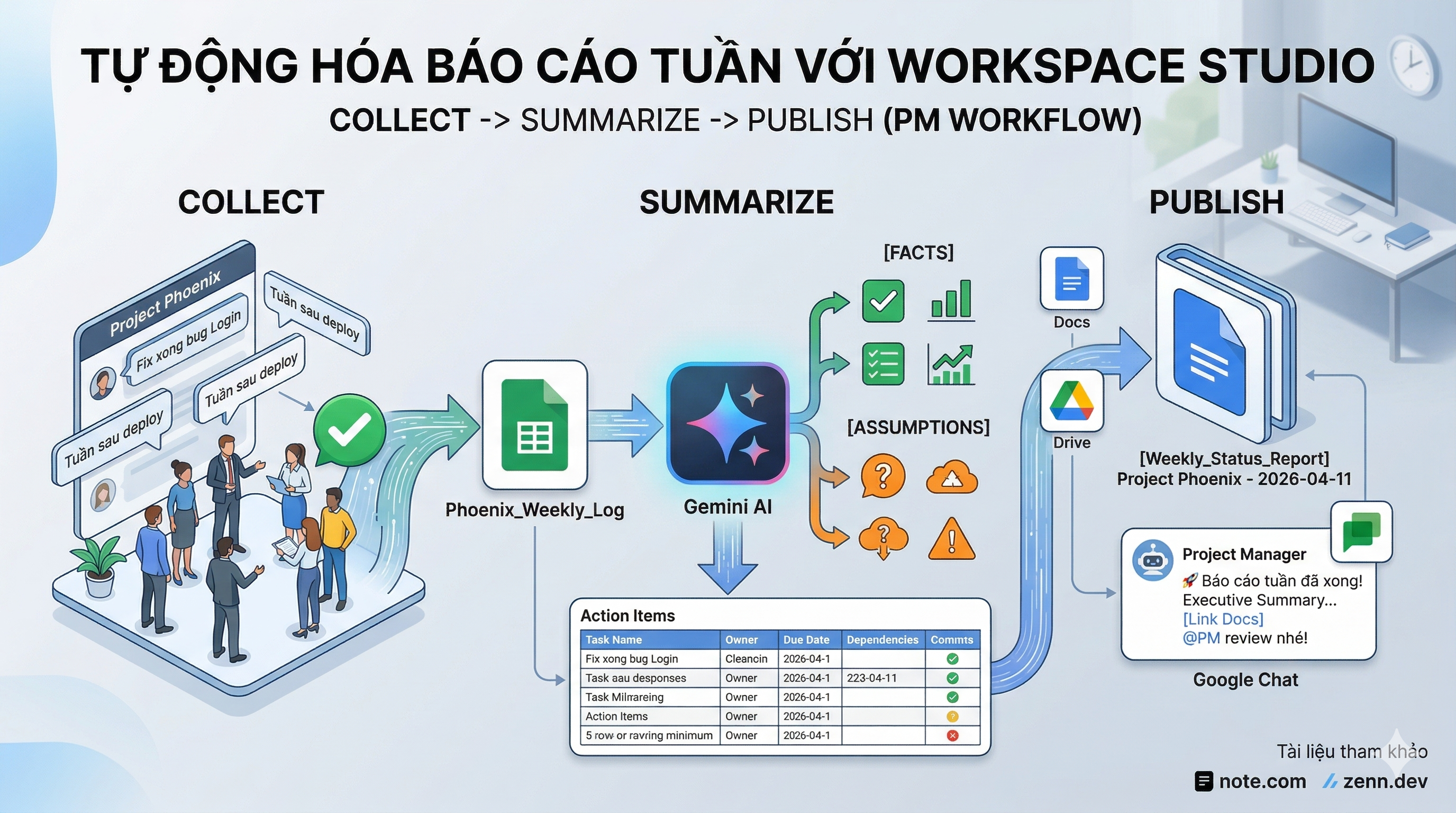

Trong một thế giới mà Trí tuệ Nhân tạo (AI) và các Mô hình Ngôn ngữ Lớn (LLMs – Large Language Models) đang thay...

We make services people love by the power of Gen AI.