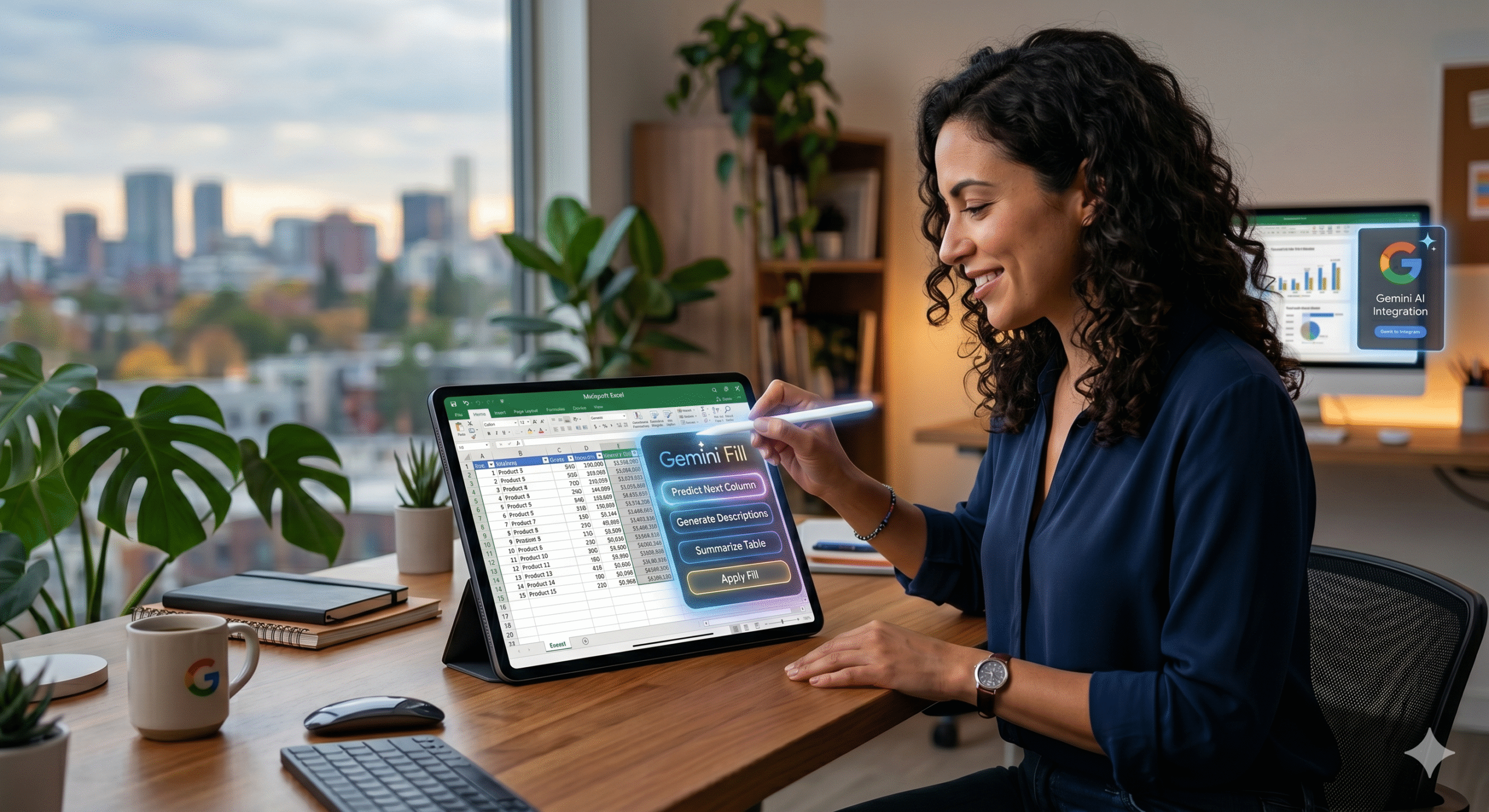

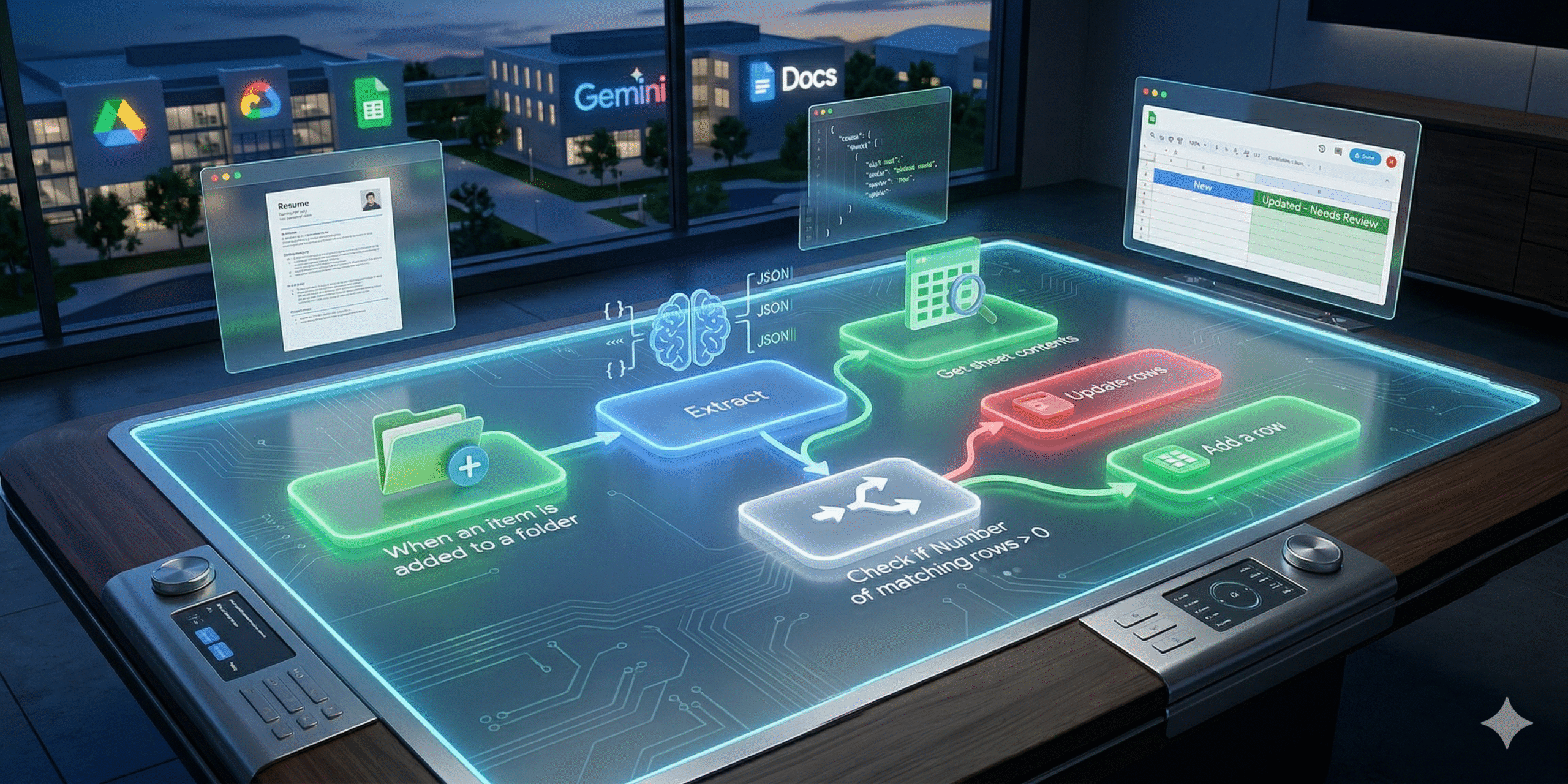

PART 1: FEATURE OVERVIEW Fill with Gemini is a smart feature in Google Sheets designed to transform spreadsheets from rigid grids into context-aware assistants....

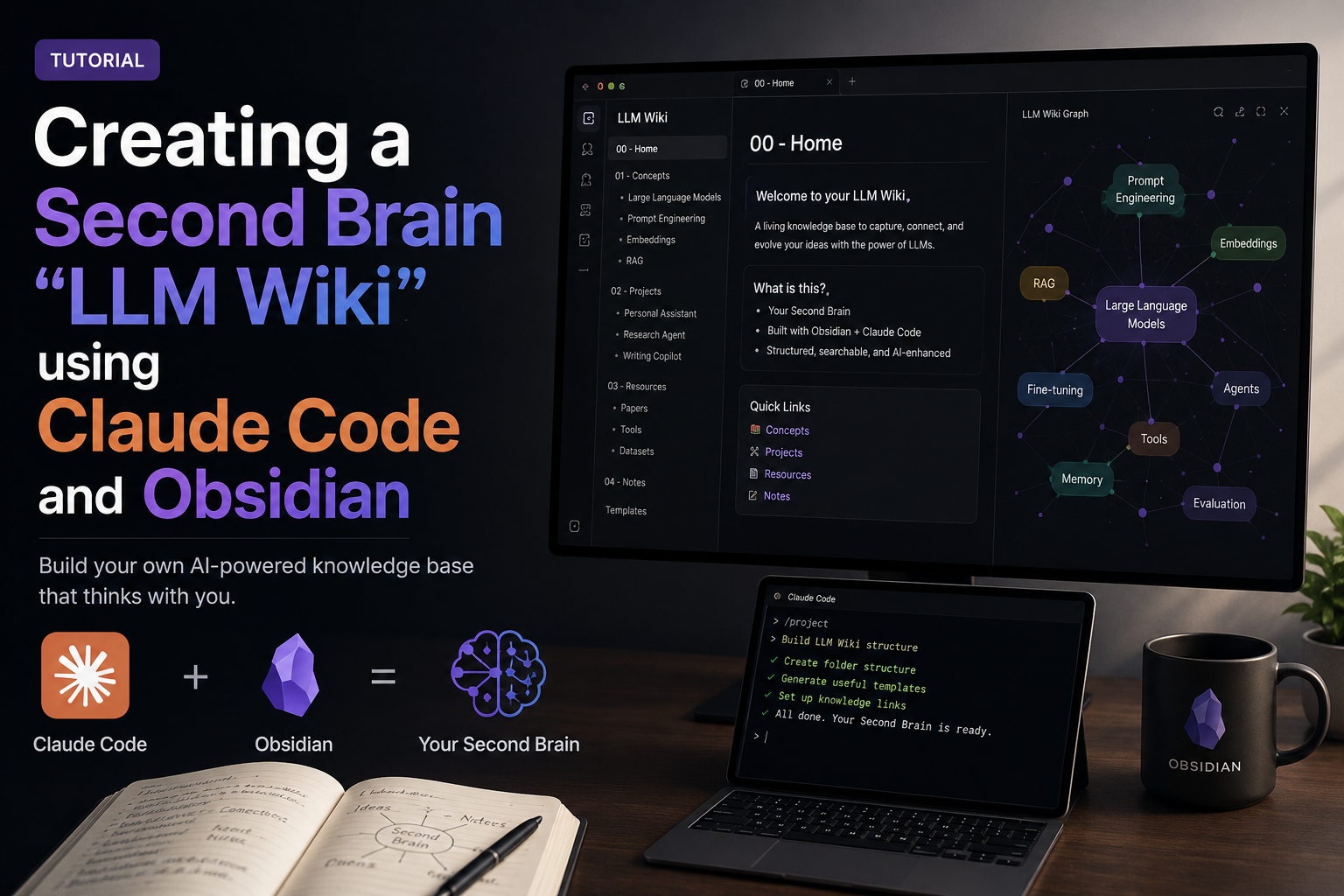

We make services people love by the power of Gen AI.