“AI không có đạo đức. Chúng ta mới là người quyết định cách nó được sử dụng.”

Kỷ nguyên AI và câu hỏi lớn về “đạo đức”

Trong vài năm gần đây, trí tuệ nhân tạo (AI) đã trở thành từ khóa nóng nhất.

Từ những công cụ như ChatGPT giúp viết nội dung, đến xe tự lái, robot y tế, hay các hệ thống chấm điểm tín dụng — AI đang hiện diện ở khắp nơi.

Nhưng càng mạnh mẽ, AI càng đặt ra những câu hỏi khó:

-

Ai chịu trách nhiệm khi AI gây sai sót?

-

AI có thể phân biệt đối xử không?

-

Dữ liệu cá nhân của chúng ta có thực sự an toàn?

-

Và liệu máy móc có thể hiểu… đạo đức con người?

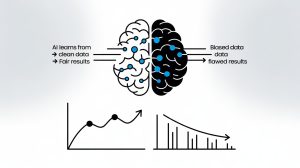

1. Khi AI “học” cả điều tốt lẫn điều xấu

AI không có đạo đức. Nó chỉ học từ dữ liệu mà con người cung cấp. Nếu dữ liệu có thiên vị, AI cũng sẽ “bắt chước” thiên vị đó.

Ví dụ:

Một công ty dùng AI để tuyển dụng, nhưng dữ liệu lịch sử chủ yếu là ứng viên nam → AI “vô tình” loại bỏ nhiều ứng viên nữ, dù họ đủ năng lực.

Giải pháp:

Các nhà phát triển cần kiểm tra dữ liệu trước khi huấn luyện AI, đảm bảo nó đa dạng và công bằng. Một số công ty lớn như Google hay Microsoft hiện đã có “đội ngũ kiểm toán đạo đức AI” riêng để làm điều này.

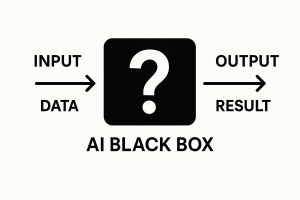

2. “Hộp đen” trí tuệ nhân tạo – khi AI ra quyết định mà không ai hiểu vì sao

Một vấn đề lớn khác là tính minh bạch. Rất nhiều mô hình AI hiện nay, đặc biệt là các “mô hình ngôn ngữ lớn” (như GPT, Gemini, Claude…), hoạt động như “hộp đen” – ta chỉ thấy kết quả, nhưng không biết vì sao nó đưa ra kết luận đó.

Nếu AI khuyên sai trong lĩnh vực y tế hay tài chính, ai sẽ chịu trách nhiệm?

Hướng đi mới:

-

Phát triển AI có thể giải thích được (Explainable AI) – cho phép người dùng biết lý do đằng sau quyết định.

-

Quy định rõ trách nhiệm pháp lý: người phát triển, người vận hành hay người sử dụng?

3. Quyền riêng tư – “dữ liệu của tôi đang ở đâu?”

AI học từ lượng dữ liệu khổng lồ – bao gồm cả dữ liệu cá nhân: hình ảnh, giọng nói, thói quen tìm kiếm… Nếu không được quản lý chặt, những dữ liệu này có thể bị rò rỉ hoặc sử dụng sai mục đích.

Bạn có bao giờ tự hỏi:

“Tôi có quyền yêu cầu AI không học từ dữ liệu của mình không?”

Ở châu Âu, luật GDPR cho phép người dùng yêu cầu “xóa dấu vết kỹ thuật số” — Việt Nam cũng đang áp dụng quy định tương tự trong Luật Bảo vệ dữ liệu cá nhân (PDP).

Giải pháp:

-

Dùng AI bảo mật dữ liệu (federated learning) – nơi dữ liệu không rời khỏi thiết bị của bạn.

-

Cung cấp tùy chọn “không dùng dữ liệu của tôi để huấn luyện AI”.

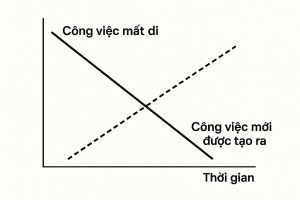

4. Khi AI thay đổi công việc của chúng ta

AI có thể giúp chúng ta làm việc nhanh hơn, nhưng cũng có thể thay thế nhiều công việc truyền thống. Nhiều người lo lắng về “làn sóng thất nghiệp công nghệ”.

Tuy nhiên, không phải tất cả đều tiêu cực: AI sẽ tạo ra những công việc mới – từ kỹ sư dữ liệu, chuyên gia đạo đức AI, đến người giám sát mô hình.

Cách ứng xử thông minh: Thay vì chống lại AI, hãy học cách làm việc cùng AI.

Ví dụ: dùng AI để hỗ trợ sáng tạo, chứ không phải để thay thế tư duy.

5. Ảnh hưởng đến tâm lý và niềm tin xã hội

Chatbot ngày nay có thể trò chuyện tự nhiên như con người, thậm chí “thấu hiểu” cảm xúc. Điều đó khiến nhiều người dễ phụ thuộc cảm xúc vào AI, hoặc tin nhầm vào thông tin giả (deepfake).

Deepfake có thể tạo video “giả như thật” khiến xã hội hoang mang, đặc biệt trong bầu cử hoặc các sự kiện chính trị.

Giải pháp:

-

Bắt buộc gắn nhãn “nội dung do AI tạo ra”.

-

Giáo dục cộng đồng về “AI literacy” – hiểu và sử dụng AI có trách nhiệm.

6. AI trong quân sự và an ninh – ranh giới mong manh

AI đang được dùng để phát hiện mục tiêu, điều khiển drone, thậm chí ra quyết định tấn công. Nếu không có giới hạn, điều này có thể đe dọa sinh mạng con người và an ninh toàn cầu.

Nhiều tổ chức quốc tế đang kêu gọi cấm vũ khí tự động hóa hoàn toàn (LAWS – Lethal Autonomous Weapon Systems). Một chiếc máy không nên có quyền quyết định sống chết của con người.

7. Khi AI cần “học đạo đức”

Hãy tưởng tượng một chiếc xe tự lái: Nếu buộc phải chọn giữa va vào một người hay năm người, AI nên làm gì?

Đó là bài toán đạo đức kinh điển — và AI chưa thể tự mình trả lời.

Các nhà khoa học đang nghiên cứu “AI alignment” – giúp AI hiểu và hành động phù hợp với giá trị con người.

8. Ở Việt Nam – Đạo đức AI là nền tảng cho “Make in Vietnam”

Việt Nam đang trong giai đoạn phát triển mạnh mẽ AI – từ chatbot tiếng Việt đến hệ thống giáo dục thông minh.

Nhưng cùng với đó là trách nhiệm:

-

Không để AI tạo nội dung sai lệch, bạo lực hoặc phản cảm.

-

Đảm bảo quyền riêng tư và dữ liệu cá nhân.

-

Xây dựng văn hóa AI vì con người, chứ không thay con người.

Kết luận: “AI tốt hay xấu – là do chúng ta”

AI không có thiện hay ác. Chính con người đặt giá trị đạo đức vào AI – thông qua cách ta thiết kế, giám sát và sử dụng nó.

Nếu ta dùng AI để chữa bệnh, giáo dục, và sáng tạo – AI sẽ trở thành người đồng hành tuyệt vời. Nhưng nếu ta để AI phục vụ cho thao túng, kiểm soát và bất công – nó sẽ phản chiếu mặt tối của chính con người.

✨ Hãy bắt đầu bằng câu hỏi đơn giản:

“Công nghệ này có giúp thế giới tốt hơn không?”Khi câu trả lời là có, đó chính là AI có đạo đức.